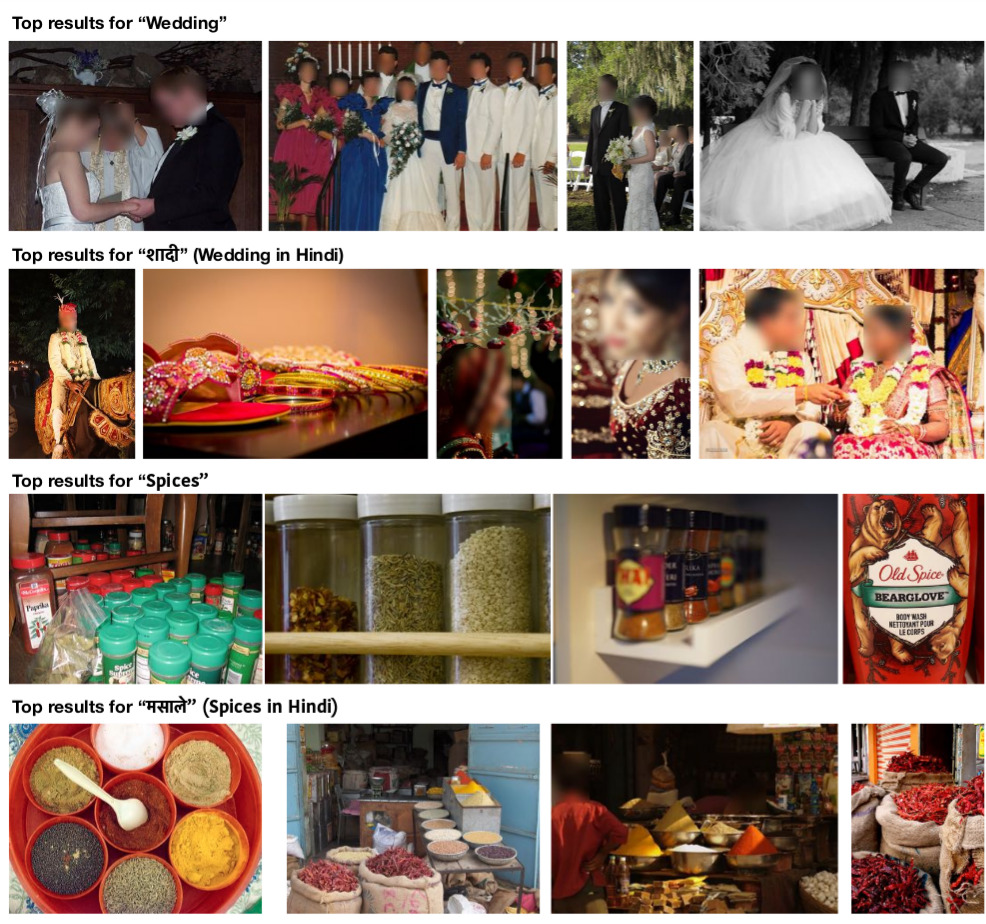

Me resultó intrigante una línea de la serie “Dear white people”, en la que un personaje afrodescendiente clama que es importante que esta comunidad haga parte activa del ciclo de desarrollo de software, ya que si no hacen parte de esto el software va a estar sesgado. Esto se ha visto en casos de clasificación de imágenes, donde los países con menores ingresos económicos no tienen resultados de clasificación tan acertados como los de países con mayores ingresos económicos. Esto está estrechamente relacionado con el origen de los datos y las variables que son consideradas para la generación de estos modelos.

Y es que este tipo de implicaciones se ven por ejemplo en NLP, ya que como la mayor parte de investigación está en universidades angloparlantes, encontrar recursos en español es un poco más difícil. Esto además tiene otras implicaciones de carácter ético, como por ejemplo un modelo de clasificación para un sistema jurídico o para préstamos bancarios, ya que son modelos sensibles con respecto a estas poblaciones.

Por esta razón las tres métricas más usadas para medir la equidad, de acuerdo a un estudio realizado en Standford son:

- Anti-clasificación: Variables como raza o género no deben ser usadas para realizar una clasificación.

- Clasificación paritaria: Las métricas de desempeño debe ser la misma para las diferentes poblaciones.

- Calibración: El score generado en un individuo con las ciertas características deben ser las mismas sin importar la población de la cual es obtenido.

Cabe notar que los mismos autores recalcan en los problemas matemáticos que representan estas métricas, ya que se trata de un área poco explorada.

Llevándolo al caso de uso empresarial, se realiza un modelo para predecir si a un cliente se le va a realizar una venta. Para probar que se cumpla la métrica de anti-clasificación al realizarse la creación del modelo se debe revisar que no se hayan usado variables sensibles como raza o género. Normalmente se tiene bastante control sobre esto, pero aún así vale la pena prestarle atención a variables compuestas o a scores generados por otros sistemas, como por ejemplo proveedores de correos.

Para probar que se haga una clasificación paritaria, se separan las poblaciones por estas variables y se les aplican las métricas de desempeño como área bajo la curva ROC, accuracy o F1. También vale destacar que el comparar visualmente las curvas ROC pueden ser de gran ayuda.

Finalmente se puede probar que la calibración se cumpla al tomar una muestra aleatoria y cambiarle los datos en las variables sensibles, y al comparar con la probabilidad de venta original no debería cambiar. Otra herramienta visual que puede generar retroalimentación sobre esta métrica es graficar un histograma de las probabilidades de cierre, y esta distribución debe ser bastante similar entre cada población.

Síguenos